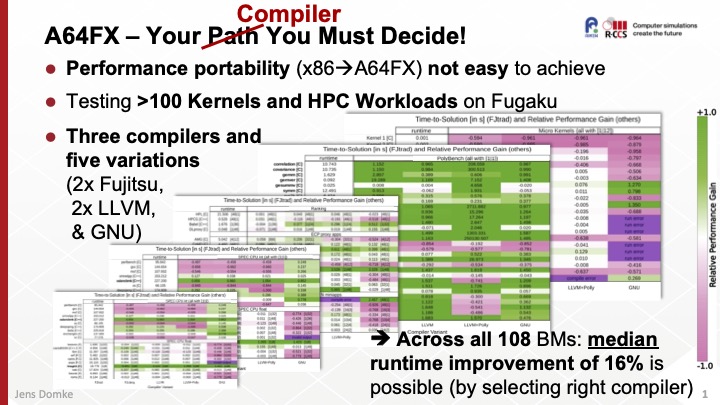

A64FX – Your Compiler You Must Decide! (FY2021)

我々は最新の3つのコンパイラを、幅広いベンチマークでテストをした。その結果、推奨されている以外の方法(4つのMPIランクと12のOpenMPスレッド)で性能が数桁向上することが分かりました。また、A64FX用の Silver bulletのようなコンパイラは、現在のところ存在しないことがわかった。

Related Publication

- J. Domke, “A64FX – Your Compiler You Must Decide!,” in Proceedings of the 2021 IEEE International Conference on Cluster Computing (CLUSTER), EAHPC Workshop, (Portland, Oregon, USA), IEEE Computer Society, Sept. 2021.

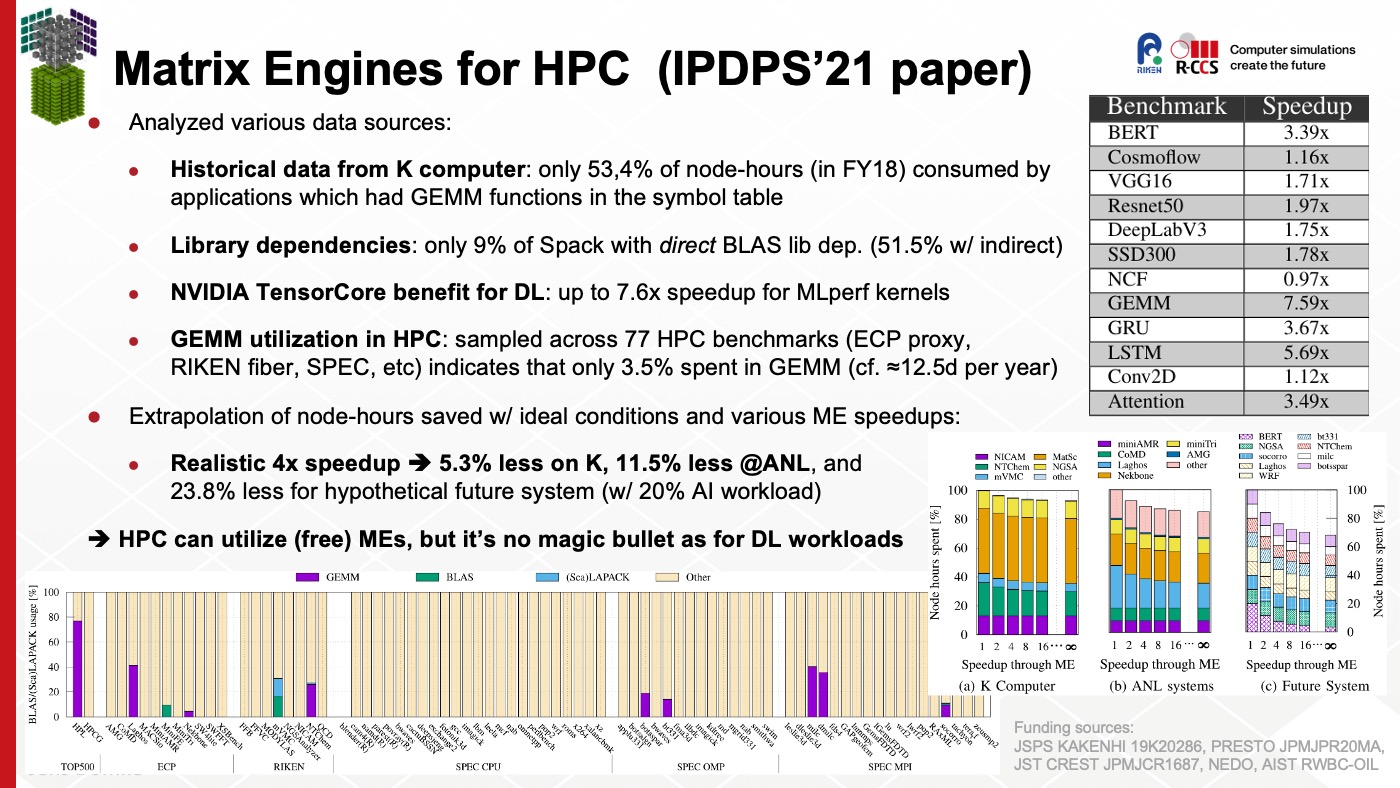

Matrix Engines for High Performance Computing: A Paragon of Performance or Grasping at Straws? (FY2021)

専用行列演算ユニットは、最新の様々なプロセッサで実装されており、特に、深層学習では行列演算(テンソル計算)で広く利用されている。また、スーパーコンピューティングにおいて Top 500で利用されている High Performance Linpackにおいても行列演算が利用されている。そこで我々は、実際に専用行列演算エンジンを利用することで、HPCや深層学習のアプリケーションにどのようなメリットがあるのかを明らかにすることを目的としました。この目的のために、ソフトウェアスタック、プロキシアプリケーション、ベンチマーク、および過去のバッチジョブの記録を詳細に調査し、最先端のプロセッサと組み合わせた場合の費用対効果を分析する。

Related Publication

- J. Domke, E. Vatai, A. Drozd, P. Chen, Y. Oyama, L. Zhang, S. Salaria, D. Mukunoki, A. Podobas, M. Wahib, S. Matsuoka, “Matrix Engines for High Performance Computing: A Paragon of Performance or Grasping at Straws?,” in Proceedings of the 35th IEEE International Parallel & Distributed Processing Symposium (IPDPS), (Portland, Oregon, USA), IEEE Computer Society, May 2021.

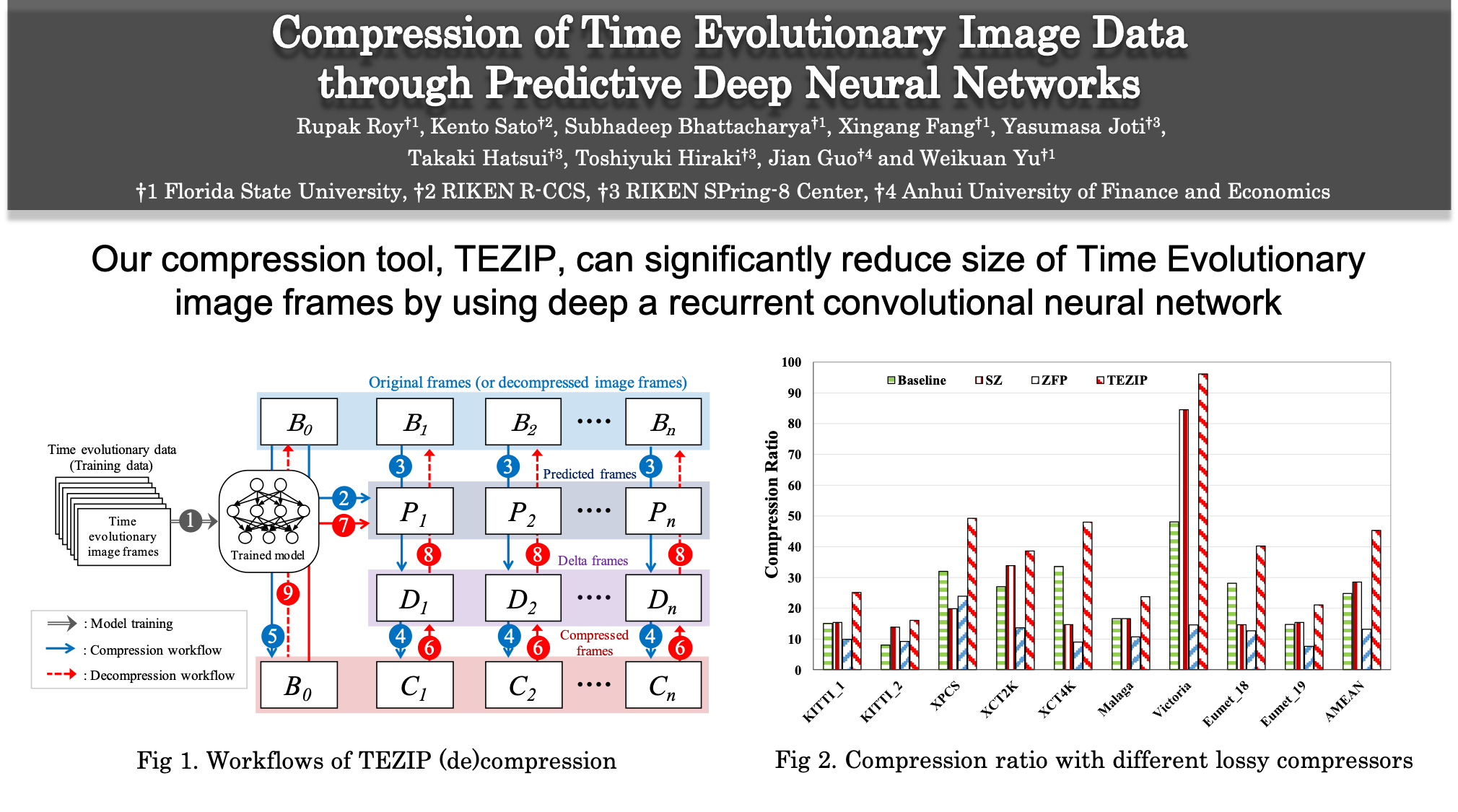

Compression of Time Evolutionary Image Data through Predictive Deep Neural Networks (FY2021)

近年のディープニューラルネットワーク(DNN)の進歩により、時間進化データの時間的・空間的局所性を予測することとが可能になっておる。本研究では、TEZIPと呼ばれるデータ圧縮フレームワークを開発しました。TEZIPは、まずPredNetと呼ばれるRecurrent Neural Networkを学習させ、ベースフレームに基づいて将来の画像フレームを予測し、その結果得られる予測フレームと実際のフレームとの差分(デルタフレーム)を計算する。次に、デルタフレームの符号化に空間的な局所性を利用し、結果として得られるフレームに可逆圧縮/非可逆圧縮を適用する技術をTEZIPに実装した。さらに、ウィンドウベースの予測アルゴリズムを導入し、ウィンドウサイズと予測フレームの相対的な誤差の間のトレードオフを動的に特定する。最後に、TEZIPを評価するために広範なテストを行い、TEZIPはx265などの既存の可逆圧縮に比べ最大3.2倍、SZなどの非可逆圧縮に比べ最大3.3倍の圧縮率が達成できることを確認した。

Related Publications

- Rupak Roy, Kento Sato, Subhadeep Bhattacharya, Xingang Fang, Yasumasa Joti, Takaki Hatsui, Toshiyuki Hiraki, Jian Guo and Weikuan Yu, “Compression of Time Evolutionary Image Data through Predictive Deep Neural Networks”, In the proceedings of the 21 IEEE/ACM International Symposium on Cluster, Cloud and Internet Computing (CCGrid 2021), May, 2021

- Rupak Roy, Kento Sato, Jian Guo, Jens Domke and Weikuan Yu, “Improving Data Compression with Deep Predictive Neural Network for Time Evolutional Data”, In Proceedings of the International Conference on High Performance Computing, Networking, Storage and Analysis 2019 (SC19), Regular Poster, Denver, USA, Nov, 2019.

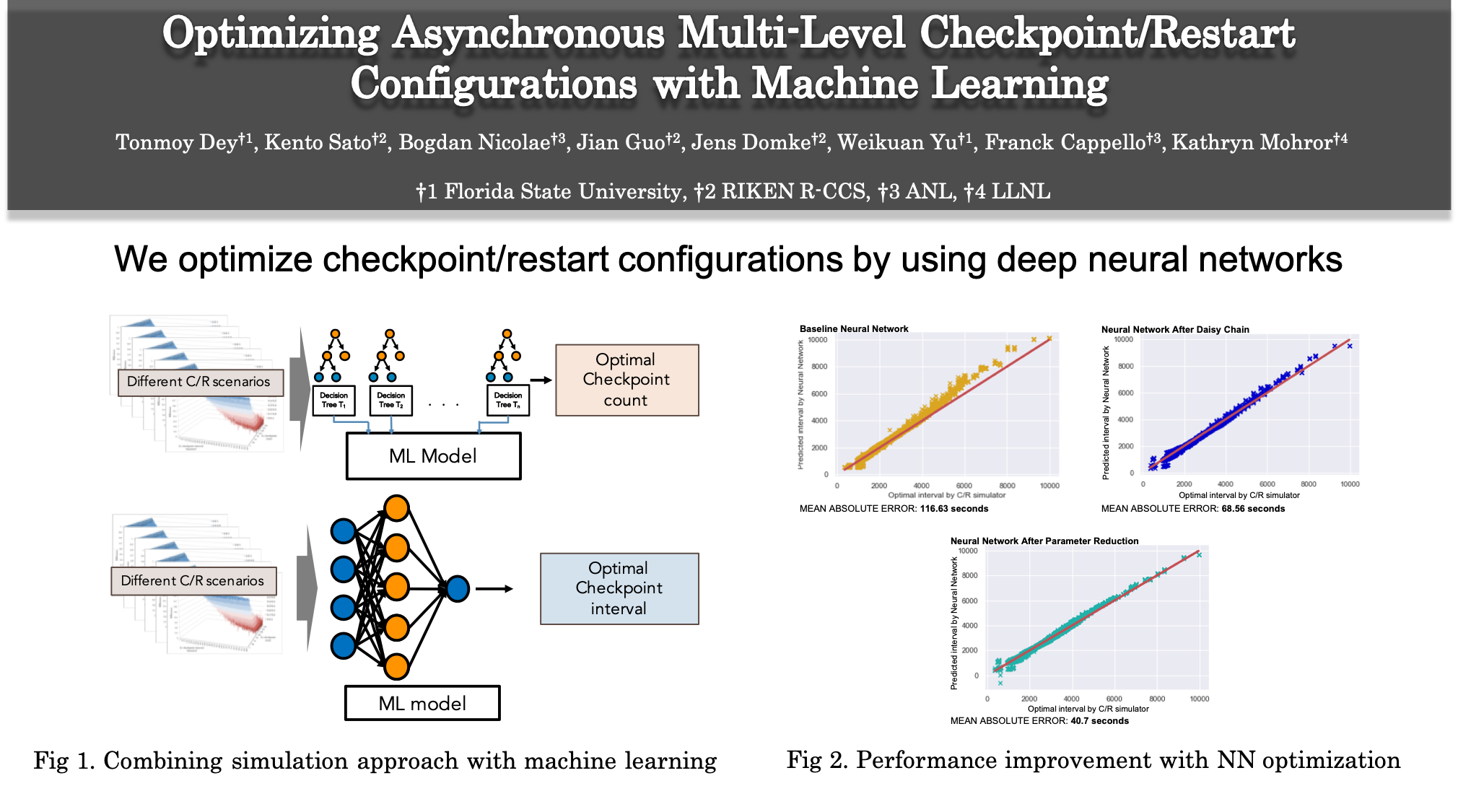

Optimizing Asynchronous Multi-Level Checkpoint/Restart Configurations with Machine Learning (FY2020)

マルチレベルチェックポインティング(MLC)は大規模アプリケーション実行の信頼性を高めるための手法として広く利用されている。しかし、マルチレベルチェックポイント/リスタートは、HPCシステムにおいて膨大なI/Oトラフィックを引き起こす可能性があるため、マルチレベルチェックポインティングを効率的に使用するためのパラメータの最適化することが重要となる。モデル化やシミュレーションといった現在のアプローチでは、大規模なシステムに最適なパラメータを決定するのは不正確であったり、時間がかかったりします。本研究では、機械学習モデルをシミュレーションと融合させることで、最適なチェックポイントパラメータを高速に決定できる手法を提案する。

Related Publications

- Tonmoy Dey, Kento Sato, Bogdan Nicolae, Jian Guo, Jens Domke, Weikuan Yu, Franck Cappello, and Kathryn Mohror. “Optimizing Asynchronous Multi-Level Checkpoint/Restart Configurations with Machine Learning.” The IEEE International Workshop on High-Performance Storage, May, 2020

- Tonmoy Dey, Kento Sato, Jian Guo, Bogdan Nicolae, Jens Domke, Weikuan Yu, Franck Cappello and Kathryn Mohror, “Optimizing Asynchronous Multi-level Checkpoint/Restart Configurations with Machine Learning”, In Proceedings of the International Conference on High Performance Computing, Networking, Storage and Analysis 2019 (SC19), Regular Poster, Denver, USA, Nov, 2019.